我們擅長商業策略與用戶體驗的完美結合。

歡迎瀏覽我們的案例。

英偉達是硬件領域的生成型人工智能之王,該公司的 GPU 為微軟、OpenAI 等公司的數據中心提供動力,運行著 Bing Chat、ChatGPT 等人工智能服務。今天,英偉達宣布了一款新的軟件工具,旨在提升大型語言模型(LLM)在本地 Windows PC 上的性能。

在一篇博客文章中,英偉達宣布了其 TensorRT-LLM 開源庫,這個庫之前是為數據中心發布的,現在也可以用于 Windows PC。最大的特點是,如果 Windows PC 配備英偉達 GeForce RTX GPU,TensorRT-LLM 可以讓 LLM 在 Windows PC 上的運行速度提高四倍。

英偉達在文章中介紹了 TensorRT-LLM 對開發者和終端用戶的好處:

在更大的批量大小下,這種加速可顯著改善更復雜的 LLM 使用體驗,如寫作和編碼助手,可同時輸出多個唯一的自動完成結果,從而加速性能并改進質量,讓用戶可以有最好的選擇。

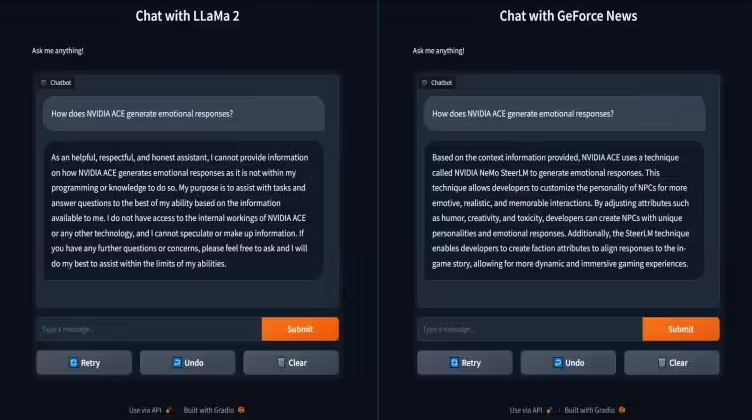

博客文章展示了一個 TensorRT-LLM 的例子。當向 LLaMa 2 基礎模型提出“《心靈殺手 2》集成了 NVIDIA 的哪些技術?”這一問題時,它給出“游戲尚未公布”這一毫無幫助的回答。相反,使用 RAG 將 GeForce 新聞添加到向量庫中,并連接到相同的 Llama2 模型,不僅得到正確答案 ——NVIDIA DLSS 3.5、NVIDIA Reflex 和全景光線追蹤,而且在 TensorRT-LLM 加速的助力下響應速度更快。這種速度與能力的結合為用戶提供更智能的解決方案。

TensorRT-LLM 很快就會在英偉達的開發者網站上提供。

英偉達今天還在新的 GeForce 驅動更新中增加了一些基于人工智能的功能。其中包括新的 1.5 版本的 RTX Video Super Resolution 功能,可以在觀看在線視頻時提供更好的分辨率提升效果和更少的壓縮效果。英偉達還為 Stable Diffusion Web UI 增加了 TensorRT 人工智能加速功能,讓擁有 GeForce RTX GPU 的用戶可以比正常情況下更快地從人工智能圖片生成器那里獲得圖像。

英偉達推出 Tensor RT-LLM,使大語言模型在搭載 RTX 的 PC 平臺上運行速度提高 4 倍 08:56:22

比亞迪海豹車型登陸澳大利亞市場,比特斯拉 Model 3 便宜約 12000 澳元 08:49:35

印度計劃在 2035 年前研制出本國空間站,并在 2040 年前實現載人登月 08:45:58

華為Mate 60/Pro推送全新鴻蒙OS 4更新:新增人像AI云增強 拍照更美了 08:38:03

吉利銀河 E8 純電轎車官圖發布:溜背設計,搭載 45 英寸 8K 大屏 10:27:03

小米推出全新操作系統澎湃 OS:小米 14 系列將率先搭載,逐步接替 MIUI 10:24:33